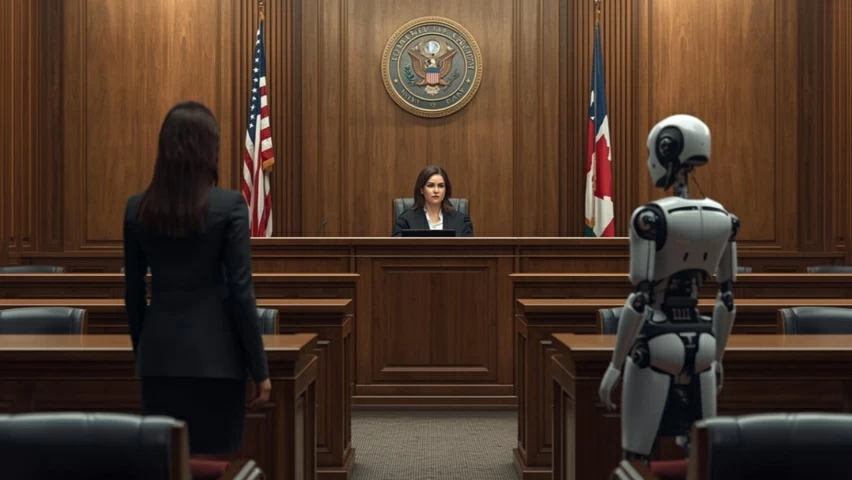

هل يمكن استخدام محادثات الذكاء الاصطناعي ضدك في المحكمة؟ قرارات أمريكية تثير الجدل – أخبار السعودية

تشهد المحاكم في الولايات المتحدة حالة من الجدل القانوني المتصاعد بسبب استخدام محادثات الذكاء الاصطناعي، بعد قرارات قضائية فتحت الباب أمام التعامل معها كأدلة في بعض القضايا.

وبدأ محامون في تحذير عملائهم من التعامل بحرية مع أدوات مثل شات جي بي تي وجيميناي، مؤكدين أن ما يُكتب داخل هذه المحادثات قد لا يبقى سرياً، بل يمكن أن يظهر داخل قاعات المحاكم.

جاء هذا التحذير بعد حكم أصدره قاضٍ فيدرالي في نيويورك، اعتبر فيه أن محادثات أحد التنفيذيين السابقين مع أداة ذكاء اصطناعي لا تتمتع بالحماية القانونية، ويمكن تقديمها كدليل في القضية. القرار استند إلى أن العلاقة بين المستخدم والمنصة ليست كالعلاقة بين المحامي وموكله، وبالتالي لا تنطبق عليها قواعد السرية.

في المقابل، لم تتفق جميع المحاكم على موقف واحد. ففي قضية أخرى بولاية ميشيغان، رفض قاضٍ اعتبار محادثات مع الذكاء الاصطناعي دليلاً قانونياً، واعتبرها مجرد جزء من تحضير الدعوى، وليست شهادة يمكن الاستناد إليها.

هذا التباين في الأحكام يعكس فجوة واضحة في التشريعات، مع تسارع استخدام الذكاء الاصطناعي في الحياة اليومية. فالمحادثات التي يجريها المستخدمون تُخزن غالباً لدى الشركات المطورة، وقد تُستخدم لاحقاً في التدريب أو تُسترجع بأوامر قانونية.

كما بدأت بعض شركات المحاماة اتخاذ خطوات وقائية، من بينها تحذير العملاء من مشاركة معلومات حساسة أو مستندات قانونية عبر هذه الأدوات، خصوصاً تلك التي تخضع لما يُعرف بسرية العلاقة بين المحامي والعميل.

ويأتي هذا الجدل في وقت يتزايد فيه اعتماد البعض على الذكاء الاصطناعي في إعداد القضايا القانونية، سواء في كتابة المرافعات أو جمع المعلومات، ما يطرح تساؤلات أوسع حول حدود هذه التقنيات ودورها داخل المنظومة القضائية.

في ظل هذا الواقع، لم يعد استخدام أدوات الذكاء الاصطناعي مجرد خيار تقني، بل أصبح مسألة قانونية قد تؤثر بشكل مباشر على مسار القضايا ونتائجها.

The courts in the United States are witnessing a rising legal controversy due to the use of artificial intelligence conversations, following judicial decisions that opened the door to treating them as evidence in some cases.

Lawyers have begun warning their clients against freely using tools like ChatGPT and Gemini, emphasizing that what is written in these conversations may not remain confidential and could appear in courtrooms.

This warning came after a ruling by a federal judge in New York, who deemed that conversations of a former executive with an artificial intelligence tool do not enjoy legal protection and can be presented as evidence in the case. The decision was based on the premise that the relationship between the user and the platform is not like the relationship between a lawyer and their client, and thus the confidentiality rules do not apply.

In contrast, not all courts have agreed on a single stance. In another case in Michigan, a judge refused to consider conversations with artificial intelligence as legal evidence, viewing them merely as part of case preparation and not as testimony that could be relied upon.

This disparity in rulings reflects a clear gap in legislation, with the rapid use of artificial intelligence in daily life. Conversations conducted by users are often stored by the developing companies and may later be used for training or retrieved through legal orders.

Some law firms have also begun taking precautionary steps, including warning clients against sharing sensitive information or legal documents through these tools, especially those that fall under what is known as the confidentiality of the attorney-client relationship.

This controversy arises at a time when some are increasingly relying on artificial intelligence to prepare legal cases, whether in drafting pleadings or gathering information, raising broader questions about the limits of these technologies and their role within the judicial system.

In light of this reality, the use of artificial intelligence tools is no longer merely a technical option but has become a legal matter that could directly impact the course and outcomes of cases.

للمزيد من المقالات

اضغط هنا